Кто хоть раз погружался в мир текстовых ролевых, тот знает это странное чувство — сидишь в метро, связь пропала, а персонаж как раз должен был ответить на самый интригующий вопрос. Обрыв. Тишина. И вся магия, которая только что лилась рекой, мгновенно рассыпается. Онлайн-сервисы вроде Character.AI или Janitor хороши, спору нет, но интернет-зависимость порой бьёт по бюджету трафика и по нервам сразу. А ведь хочется иногда просто закрыться от мира и поговорить с любимым героем где-нибудь в поезде, на даче или в самолёте. Поэтому стоит присмотреться к офлайн-вариантам — благо, технологии за последние пару лет шагнули так, что запустить полноценную нейросеть на смартфоне или ноутбуке уже не фантастика.

Что такое офлайн-ролка и зачем она нужна

Офлайн-ролёвка — это та же самая текстовая игра с ИИ-персонажем, только без серверов где-то в Калифорнии. Модель крутится прямо на вашем устройстве, переписка не уходит в чужие логи, а цензура отсутствует как класс. Звучит сказочно? Отчасти да. Но есть и обратная сторона медали: качество ответов сильно зависит от железа, а сама модель занимает несколько гигабайт памяти. Зато никаких лимитов сообщений, никаких «модель перегружена, попробуйте позже» и никаких неловких ситуаций, когда сервис вдруг решает зарезать половину сюжетов.

К тому же приватность — это уже не модное слово, а реальная необходимость. Ведь любая ваша переписка с облачным ботом теоретически может всплыть где-то в датасете для следующей версии. Локальная же модель молчит как партизан.

На каком устройстве это вообще потянет

Главный вопрос, который встаёт первым — а железо-то справится? Тут всё зависит от того, на что вы замахнулись. Совсем простенький телефон с 4 ГБ оперативки потянет крошечные модели на 1–3 миллиарда параметров, и ответы будут, скажем мягко, наивные. А вот аппарат с 8–12 ГБ ОЗУ уже спокойно крутит модели в диапазоне 7B, и качество вполне приличное для бытовой ролки. На ноутбуке или ПК с дискретной видеокартой (хотя бы 6 ГБ видеопамяти) разворачиваются куда более серьёзные модели — 13B, а то и 20B в квантованном виде. Не стоит забывать и про планшеты — современные iPad с чипами М-серии справляются на удивление бодро. К слову, владельцам Mac на Apple Silicon вообще повезло: тамошняя архитектура с общей памятью словно создана для нейросетей.

Выбор приложения для смартфона

Тут нужно отметить, что мобильный сегмент развивается семимильными шагами. Если ещё года два назад запуск LLM на телефоне казался чем-то на грани шаманства, то сейчас в магазинах приложений лежат вполне юзер-френдли решения. Самый известный игрок — это, конечно, ChatterUI для Android. Бесплатное, с открытым кодом, поддерживает загрузку моделей в формате GGUF и удобно работает с карточками персонажей в формате PNG (тот самый, что используется в SillyTavern). Установка простая: качаете APK с GitHub разработчика, даёте разрешения на работу с файлами, кладёте модель в нужную папку. И всё, можно подключать карточку и начинать диалог.

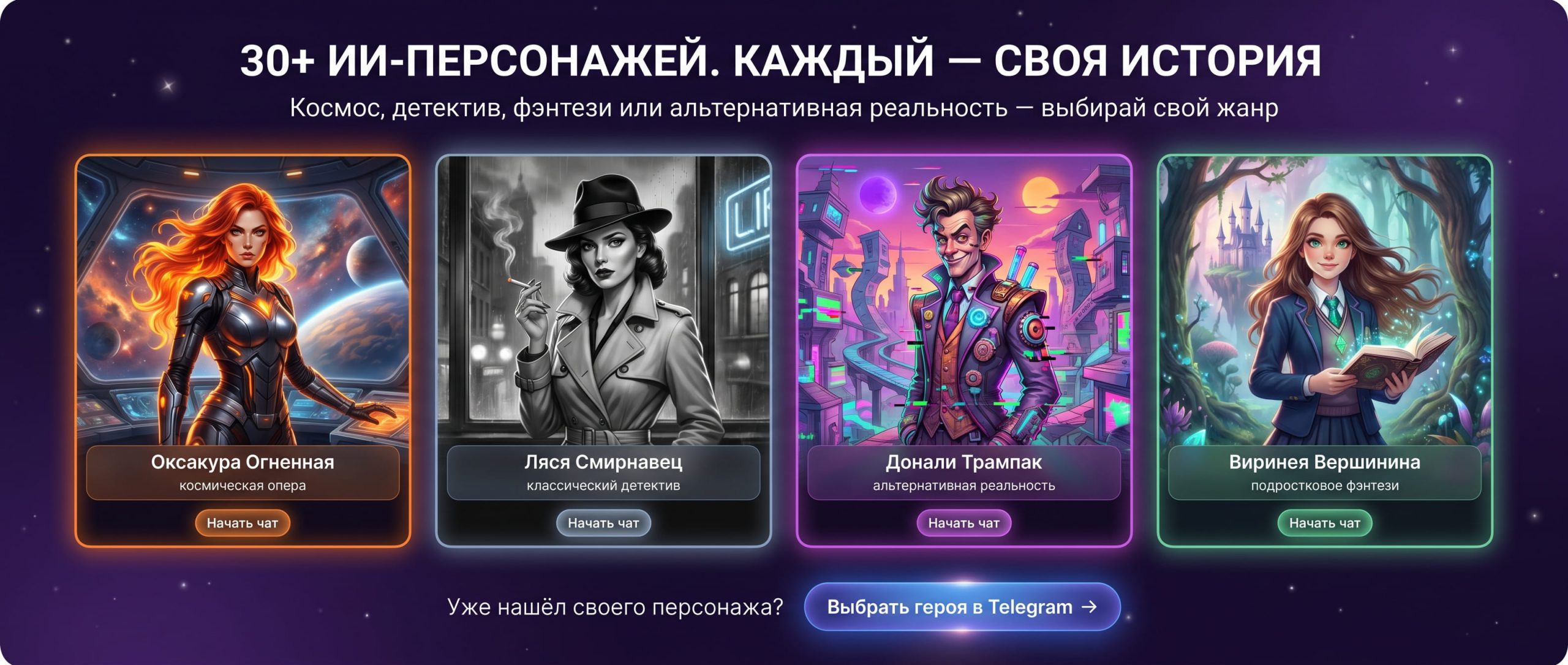

Целое приключение — в одном телеграм-боте 🌍

Не нужно ничего скачивать, регистрироваться и разбираться в сложных интерфейсах. Открыли Telegram — и вы уже в текстовой ролевой игре с ИИ. Идеально на 10 минут в обеденный перерыв или на целый вечер: история подождёт и продолжится с того же места, где вы остановились.

Открыть бота 👉 https://clck.ru/3Ta8kQ

Альтернатива — Layla Lite, тоже под Android. Интерфейс посимпатичнее, но часть функций спрятана за платной версией. Для iOS выбор поскромнее: тут солирует приложение PocketPal, бесплатное и довольно шустрое, хотя с карточками персонажей работает не так гибко. Ну и, конечно же, нельзя не упомянуть Maid — кроссплатформенное решение, которое подойдёт и тем, кто сидит на «зелёном роботе», и владельцам «яблок». Какое выбрать? Зависит от того, насколько глубоко вы хотите погрузиться. Для первого знакомства ChatterUI — оптимальный вариант.

Где брать саму модель

Вот тут начинается самое интересное. Приложение — это лишь оболочка, пустая комната. А чтобы в ней появился собеседник, нужна сама нейросеть, то есть файл с весами модели. Главный склад всего этого добра — портал Hugging Face. По сути, это GitHub для ИИ-моделей, где разработчики со всего мира выкладывают свои творения. Для ролёвки особенно ценятся модели семейств Mythomax, Kunoichi, Fimbulvetr, Stheno, а также свежие Llama 3-based сборки от энтузиастов вроде TheDrummer или Sao10K. Имена эти на слуху у тех, кто плотно сидит в теме, а для новичка звучат как заклинания. Не стоит этого пугаться.

Скачивать нужно файлы с расширением .gguf — это специально упакованный, «сжатый» формат, который понимает большинство мобильных приложений. Рядом с названием модели вы увидите буквенно-цифровые обозначения: Q4_K_M, Q5_K_S, Q6_K и тому подобное. Это уровни квантования — степень сжатия. Чем выше цифра, тем лучше качество, но и тем больше весит файл. Q4_K_M — золотая середина для большинства случаев.

Q8 — почти оригинальное качество, но для телефона уже тяжеловато. К слову, средний файл модели 7B в квантовании Q4 весит около 4 ГБ, а 13B — порядка 7–8 ГБ. Так что место на диске придётся освободить.

Карточки персонажей: где находить и как подключать

Допустим, модель скачана, приложение работает. Но кто будет вашим собеседником? Безликая нейросеть отвечает скучно. Магия начинается, когда вы подгружаете карточку персонажа — небольшой файл с описанием характера, биографии, манеры речи и стартовой сцены. Главная сокровищница таких карточек — сайт Chub.ai (бывший CharaHub), а также Pygmalion-сообщества и тематические каналы в Telegram. Карточка обычно скачивается в виде PNG-картинки, в метаданные которой и зашит весь текст. Удивительно, но картинка работает как контейнер.

Подключение элементарное: открываете в приложении раздел «персонажи», нажимаете «импорт», выбираете скачанный PNG — и готово, перед вами уже сидит виртуальный собеседник с прописанным характером. Хотя и звучит просто, но первый раз всё-таки придётся повозиться с настройками — выбрать пресет промпта (формат, в котором модель «понимает» диалог), отрегулировать температуру (творческость ответов) и context size (объём памяти диалога). Стоит поэкспериментировать. Ведь именно от этих параметров зависит, будет ли персонаж живым или превратится в говорящую табуретку.

Установка на ПК: тяжёлая артиллерия

Если экранчик смартфона мал, а душа просит размаха, то стоит задуматься о настольной версии. Тут вне конкуренции связка из двух программ: KoboldCpp в качестве движка и SillyTavern в роли красивого интерфейса. Кобольд — это маленькая утилита, которая загружает модель и поднимает локальный сервер на вашем компьютере. SillyTavern же подключается к этому серверу и даёт всё то, ради чего люди и идут в офлайн: красивые аватарки, групповые чаты, лорбуки (базы знаний по миру ролёвки), регенерацию ответов, swipe-варианты и сотни мелких удобств.

Процесс не сложный, но кропотливый. Сначала качается KoboldCpp с GitHub (один исполняемый файл, никакой установки), затем в него подгружается GGUF-модель. Параллельно ставится SillyTavern — она требует Node.js, но скрипт-инсталлятор делает почти всё сам. Запускаете оба окна, в Таверне указываете адрес локального сервера (обычно 127.0.0.1:5001) — и можно играть хоть в самолёте на высоте десять тысяч метров. К тому же на ПК доступны модели потяжелее, а значит и диалоги выходят глубже, осмысленнее, с лучшей памятью на детали.

Подводные камни и нюансы

Розовых очков всё-таки лучше не надевать. Локальные модели — это не GPT-4, и ждать от них шекспировских монологов не стоит. Маленькая модель на телефоне может повторяться, забывать имена, путать пол персонажа или вдруг свалиться в бесконечный цикл одной и той же фразы. Это нормально для технологии в её текущем виде. Скорость генерации тоже неоднозначный момент: на смартфоне ответ в пару абзацев может писаться двадцать-тридцать секунд (а на старом аппарате и больше минуты). Батарея при этом тает на глазах, а корпус нагревается так, что им хоть руки грей зимой.

К тому же память диалога ограничена контекстным окном — обычно это 4096 или 8192 токена (примерно 3–6 тысяч слов). Когда лимит исчерпан, модель начинает «забывать» начало беседы. Спасательный круг тут — лорбуки и summary, краткие пересказы предыдущих событий, которые подгружаются в промпт.

Но это уже тонкая настройка для продвинутых пользователей. Начинающему же стоит просто принять: офлайн-ролка хороша как автономный вариант, а не как полная замена облачным сервисам. Хотя и тут прогресс идёт настолько стремительно, что через год-другой эти ограничения, скорее всего, останутся в прошлом.

Безопасность и легальность

Многие думают, что скачивание моделей с Hugging Face — какая-то серая зона. На самом деле почти все модели для ролки распространяются по открытым лицензиям (Apache 2.0, MIT, Llama Community License). То есть пользоваться ими можно свободно, в том числе и для личных целей. С карточками персонажей похожая история — авторы выкладывают их добровольно, и скачивание полностью легально. Но и тут есть свои нюансы: не стоит качать модели с сомнительных торрентов или зеркал. Известны случаи, когда в .gguf-файлы пытались зашить вредоносный код, хотя сам формат к этому плохо приспособлен. Лучше пользоваться официальным репозиторием и проверенными авторами с десятками тысяч скачиваний.

Ну и, конечно же, стоит позаботиться о пространстве. Несколько моделей плюс пачка карточек легко съедают 30–40 гигабайт на устройстве. Если планируете серьёзно увлечься этим хобби, то микро-SD карта на 128 ГБ или внешний SSD станут отличным решением. К слову, скачивать сами модели лучше дома по Wi-Fi — мобильный трафик такой объём не вытянет, да и кошелёк станет легче.

Несколько практических советов напоследок

Первая модель не обязательно должна быть самой большой. Начните с чего-то скромного — например, Kunoichi-DPO-v2-7B в квантовании Q4_K_M. Файл небольшой, скорость приличная, а характер у модели живой. Распробуете — потом перейдёте на 13B или экспериментальные сборки. Не стоит сразу загружать в приложение десять разных моделей: толку мало, а память забьётся. Лучше иметь две-три проверенные и хорошо настроенные. Тем более, что переключаться между ними в большинстве приложений можно за пару тапов.

Отдельно стоит упомянуть про сохранения. Локальные приложения не синхронизируются с облаком (в этом, собственно, и весь смысл), поэтому периодически экспортируйте чаты в текстовый файл или JSON. Бэкап — это та самая мелочь, о которой все вспоминают только после того, как телефон утоплен в чае. А история переписки иногда складывается такая, что её хочется перечитывать как любимую книгу. Удачи в офлайн-приключениях — пусть ваш виртуальный мир работает там, где не ловит даже LTE, и пусть каждый диалог запомнится надолго.