Бывает так, что хочется отыграть сцену с любимым персонажем, прокачать сюжет своей вселенной или просто поболтать с виртуальным собеседником — а связи нет. Метро, самолёт, дача за городом, где сигнал ловит только если встать на табуретку и вытянуть руку к потолку. И вот тут-то обычные онлайн-сервисы вроде Character.AI или Janitor превращаются в красивую, но бесполезную иконку на экране. Ролка без интернета — задача не из лёгких, но вполне посильная, если знать, куда смотреть и что ставить на смартфон или ноутбук.

Что вообще такое офлайн-ролка с ботом?

Если коротко — это общение с языковой моделью, которая крутится прямо на вашем устройстве, без обращения к удалённым серверам. Никаких облаков, никакой ежемесячной подписки, никаких блокировок по региону. Модель скачивается один раз, занимает на диске от пары до десятка гигабайт, и дальше работает автономно. Звучит как магия, но на самом деле — обычная инженерия последних двух лет. Раньше для такого требовался компьютер ценой как подержанный автомобиль, а сейчас довольно скромный смартфон с восемью гигабайтами оперативки уже тянет вполне приличного собеседника.

Чем хорош такой подход? Во-первых, приватность. Ваши откровенные диалоги, фанатские сценарии и личные переписки остаются на устройстве и никуда не утекают. Во-вторых, отсутствие цензуры — большинство локальных моделей либо изначально расцензурены, либо легко настраиваются. В-третьих, скорость отклика порой даже выше, чем у онлайн-аналогов, особенно если у провайдера в часы пик сервера дымятся.

Ложка дёгтя тоже есть — качество ответов локальной модели среднего размера всё-таки уступает топовым облачным гигантам. Но разрыв сокращается с каждым месяцем.

PocketPal AI — карманный вариант для Android и iOS

Начать стоит с самого простого. PocketPal — это, пожалуй, лучшее приложение для тех, кто впервые слышит про офлайн-нейросети и не хочет копаться в настройках по три часа. Скачиваешь из Play Market или App Store, открываешь, выбираешь модель из встроенного каталога — и через пару минут уже идёт диалог. Никаких терминалов, никаких файлов конфигурации, никаких «положите GGUF в папку models».

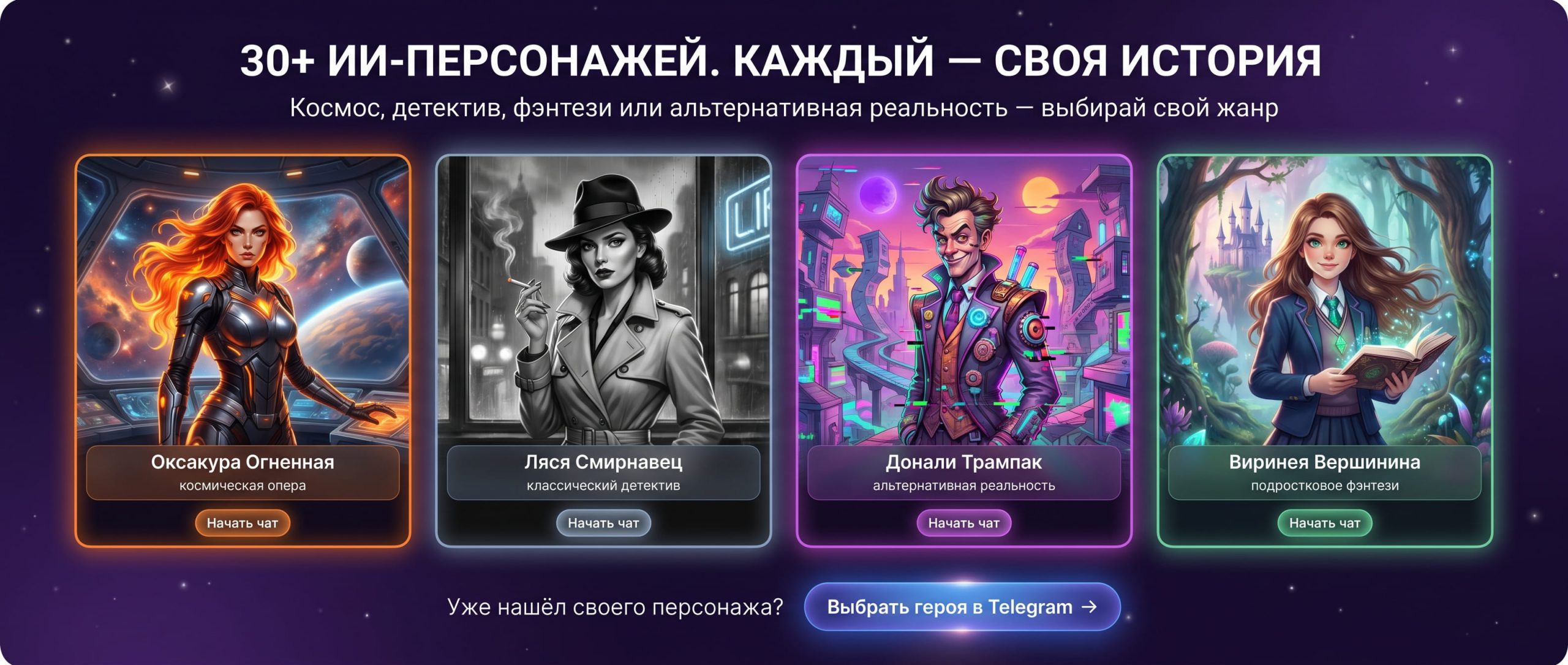

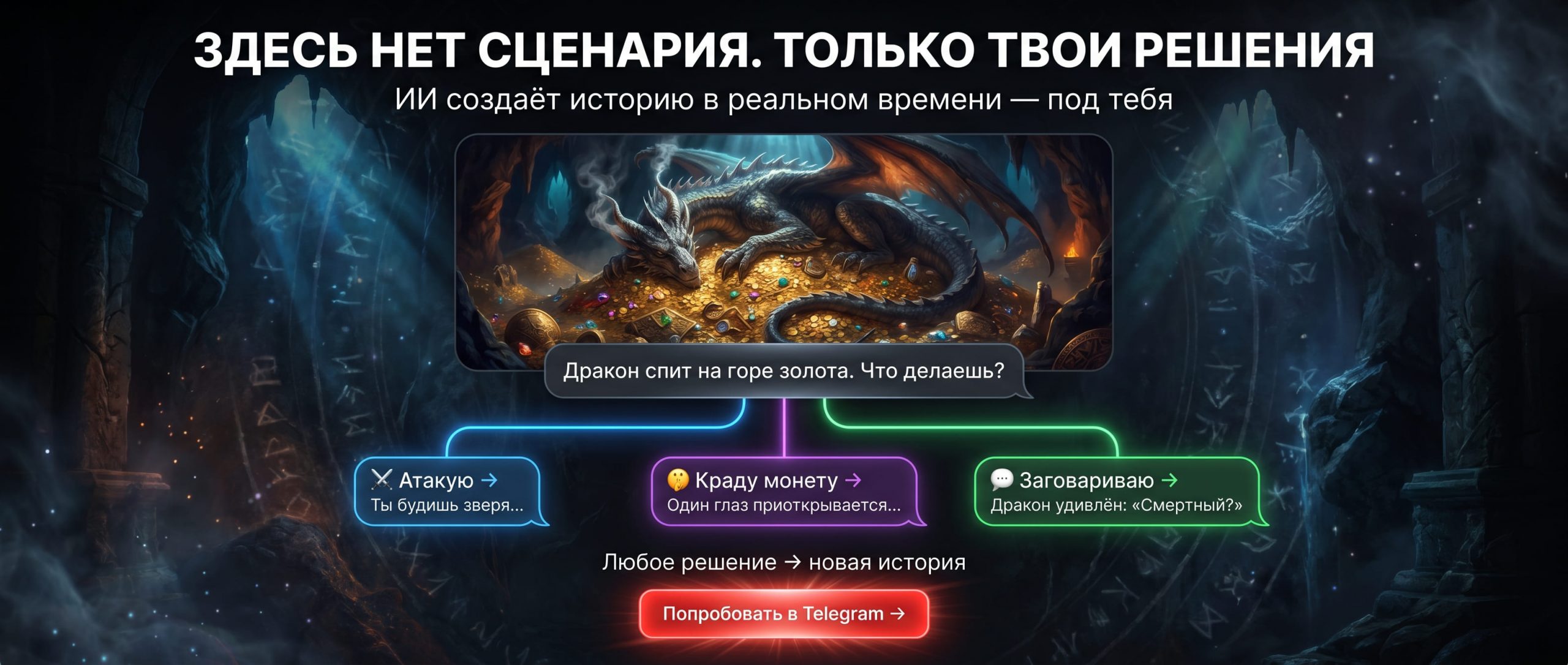

Текстовые ролевые игры с ИИ — прямо в Telegram 🎭

Большой выбор готовых персонажей и сюжетов на любой вкус: фэнтези, романтика, детектив, мистика, повседневность. Каждый герой со своим характером и манерой речи. Просто откройте бота, выберите персонажа — и вы уже внутри истории.

Выбрать персонажа и начать игру 👉 https://clck.ru/3Ta8kQ

Внутри — поддержка популярных компактных моделей вроде Llama 3.2, Phi-3, Gemma 2 и Qwen 2.5 в квантованных версиях (Q4, Q5, Q8). Для ролки лучше брать что-то посочнее — например, файнтюны на базе Llama 3 размером 7-8 миллиардов параметров. Они уже умеют держать характер персонажа, не путать местоимения и выдавать развёрнутые описания сцен. К слову, в приложении есть система пресетов — можно сохранить системный промт для каждого героя отдельно. Удобно, если у вас целая галерея виртуальных собеседников.

Минусы? Куда же без них. Большие модели на бюджетных смартфонах тормозят, аккумулятор греется и тает на глазах. Да и контекстное окно приходится держать поджатым, иначе телефон начинает откровенно страдать.

Layla — заточенный под ролевые сценарии

Особый интерес вызывает Layla. Это уже не универсальный чат, а специализированный инструмент, созданный с прицелом именно на ролевую игру и компаньонское общение. Внутри — встроенная карточная система персонажей, совместимая с форматом Character Card V2 (тем самым, что используется в SillyTavern). То есть карточки с Chub.ai или с любых других ресурсов спокойно импортируются и работают.

В чём изюминка? Layla поддерживает не только текст, но и генерацию изображений через локальные модели вроде Stable Diffusion Lite, синтез голоса и даже распознавание речи. Получается этакий мини-комбайн: персонаж не только пишет, но и говорит, и присылает картинки. Конечно, всё это пожирает ресурсы устройства, и без флагманского чипа полный набор не запустишь. Но даже в урезанном режиме (только текст) приложение работает достойно.

Распространяется Layla по модели freemium — базовая версия бесплатна, расширенная стоит около десяти долларов разовым платежом. Не сильно ударит по кошельку, особенно если учесть, сколько просят за месячную подписку конкуренты онлайн.

KoboldCpp — старая школа для тех, кто не боится файлов

А вот это уже инструмент для пользователей посерьёзнее. KoboldCpp — не приложение в привычном смысле, а скорее небольшая программа-сервер, которая запускает языковую модель локально и предоставляет к ней доступ через браузер. Работает на Windows, Linux, macOS и даже на Android через Termux (хотя последний путь — для самых отчаянных).

Зачем оно нужно, если есть PocketPal? Дело в том, что KoboldCpp даёт несравнимо больше контроля. Можно крутить температуру, top-p, top-k, repetition penalty, подключать лорбуки, использовать сложные системные промты в несколько тысяч токенов. К нему отлично цепляется SillyTavern — та самая легендарная оболочка, в которой ролевики проводят часы за настройкой персонажей, мира и сценариев.

Связка KoboldCpp + SillyTavern, развёрнутая на одном устройстве без интернета, — это, пожалуй, золотой стандарт автономной ролки. Поднимается всё локально, общение идёт через localhost, а значит, сеть не нужна вообще.

LM Studio — для владельцев ноутбуков и десктопов

Если основной площадкой выступает не телефон, а ноутбук — присмотритесь к LM Studio. Программа выглядит как обычный мессенджер, только вместо собеседников в списке — модели. Скачать, выбрать, запустить, общаться. Поиск моделей встроен прямо в интерфейс, тянет напрямую с Hugging Face. Бери, что нравится.

Для ролки тут раздолье. Хорошо идут файнтюны вроде Mythomax, Stheno, Lumimaid, MN-12B-Lyra — это всё проверенные временем модели, заточенные на художественное письмо и характерные диалоги. На машине с 16 гигабайтами оперативки и приличной видеокартой можно крутить модели 12-13B без особых проблем. С 32 ГБ открывается дорога к 20-22B, а это уже совсем другой уровень — почти не отличить от облачного сервиса среднего пошиба.

Кстати, в LM Studio есть встроенный сервер с OpenAI-совместимым API. Это значит, что программу можно использовать как бэкенд для той же SillyTavern или для любого другого фронтенда. Универсальное решение.

А что насчёт совсем слабых устройств?

Что делать, если телефон трёхлетней давности, оперативки четыре гигабайта, а ролки хочется? Не всё потеряно. Существуют ультра-компактные модели — Qwen 2.5 1.5B, Llama 3.2 1B, TinyLlama. Они, конечно, не блещут литературным талантом, но базовые сценарии тянут. Для коротких диалогов в духе «привет, как дела, расскажи, что случилось в твоём городе» — вполне достаточно.

Запустить их можно через тот же PocketPal или через приложение MLC Chat — оно использует особую оптимизацию под мобильные процессоры и работает шустро даже на середняках. Не ждите чудес, но базовое общение получите.

Какую модель выбрать под ролку?

Вопрос на миллион. Универсального ответа нет, но кое-какие ориентиры назвать можно. Для слабых устройств — Gemma 2 2B или Llama 3.2 3B, файнтюненные под ролеплей (ищите в названии слова roleplay, rp, uncensored). Для среднего сегмента — Llama 3 8B Stheno или Lunaris, NeuralDaredevil 8B. Это рабочие лошадки, которые держат характер и не разваливаются после двадцати реплик.

Для мощных машин раздолье — Mistral Small 22B, Cydonia, Magnum, Midnight Miqu (если найдёте). Эти ребята уже на голову выше: помнят детали из начала диалога, плетут сюжетные арки, выдают эмоционально насыщенные сцены. Но и требования соответствующие — без хорошей видеокарты или хотя бы 24 гигабайт оперативки лучше не подходить.

Подводные камни автономной ролки

Не всё гладко в королевстве офлайн. Есть нюансы, о которых стоит знать заранее. Первый — память. Контекстное окно локальных моделей обычно меньше, чем у облачных, и держать многочасовую беседу без потерь сложно. Бот может забыть, что вы ему рассказали полчаса назад. Лечится это вручную — через краткие пересказы (саммари), лорбуки и регулярную чистку диалога.

Второй — нагрев и расход батареи. Запущенная нейросеть жрёт энергию, как голодный подросток пиццу. На длительных сессиях телефон стоит держать на подзарядке или мириться с тем, что заряд тает на глазах. Ноутбуки греются меньше, но кулеры всё равно шумят.

Третий — качество. Локальная модель 8B — это не GPT-4. Иногда она путает имена, ломает четвёртую стену, выдаёт логические нестыковки. Не стоит ждать чудес от компактных версий, и не стоит расстраиваться, когда герой вдруг забывает, что у него зелёные глаза.

Зачем вообще всё это нужно?

Кому-то покажется, что овчинка выделки не стоит — мол, зачем мучиться с настройкой, если есть готовые онлайн-сервисы. Но есть категории людей, для которых офлайн — не каприз, а необходимость. Те, кто часто путешествует и работает в разъездах. Те, кто живёт в регионах с нестабильным интернетом. Те, кто принципиально не хочет отправлять личные тексты на чужие серверы. И, наконец, те, кому просто нравится сам процесс — настраивать, тюнить, выжимать максимум из железа.

Локальные модели за последний год сделали гигантский рывок. То, что вчера казалось научной фантастикой, сегодня помещается в карман. И этот тренд явно не остановится — впереди и более компактные архитектуры, и улучшенные методы квантизации, и оптимизация под NPU мобильных чипсетов.

Удачи в выборе подходящего приложения и захватывающих сюжетов — пусть ваш карманный собеседник окажется именно тем, о ком вы давно грезили. А отсутствие интернета пускай станет не препятствием, а поводом наконец-то отыграть ту самую сцену, до которой раньше не доходили руки.